Codex Securityとは?OpenAIの脆弱性検証・パッチ提案機能とSASTとの違いを解説

OpenAIの Codex Security は、コードの脆弱性を見つけるだけでなく、検証し、修正案まで提示するためのアプリケーションセキュリティ向けAIエージェントです。2026年5月1日時点ではresearch previewとして案内されており、GitHubリポジトリに接続して使う形が中心です。

結論から言うと、Codex Securityは「SASTのAI版」と見るより、コードベース固有の脅威モデルを作り、現実的な攻撃経路を探索し、sandboxで再現検証したうえで、人間レビュー用のパッチ案を出す仕組みです。自動で本番コードを書き換える機能ではなく、セキュリティ担当者と開発者のtriage、修正レビュー、PR作成を支援するものとして理解すると安全です。

本記事のポイント

- Codex Securityは、リポジトリを読んで脅威モデルを作り、脆弱性の発見、検証、修正提案までを支援するOpenAIのセキュリティエージェントである。

- 2026年5月1日時点ではresearch previewで、GitHubリポジトリ連携、sandbox検証、人間レビュー前提のパッチ提案が中心になる。

- SASTの代替ではなく、既存の静的解析や依存関係スキャンで守れる領域を残し、文脈依存の脆弱性や修正triageを補う位置づけで考えるべきである。

この記事で扱うテーマ

関連キーワード

- Codex Security

- Codex Security とは

- OpenAI Codex Security

- Codex Security 使い方

- Codex Security SAST 違い

- Codex Security 脆弱性

- Codex Security GitHub

- Codex Security パッチ

このページで答える質問

- Codex Securityとは何か?

- Codex Securityは何ができるのか?

- Codex SecurityとSASTの違いは何か?

- Codex Securityを企業で使うときの注意点は何か?

Codex Securityとは何か

Codex Securityは、OpenAIが2026年3月6日に発表したアプリケーションセキュリティエージェントです。OpenAIの公式発表では、以前Aardvarkとして進められていた取り組みをCodex Securityとしてresearch previewにしたものと説明されています。目的は、低品質な大量アラートを増やすことではなく、コードベースの文脈を読んで、実際に意味のある脆弱性を高い確度で見つけることです。

OpenAI Help Centerの説明では、Codex SecurityはGitHubリポジトリへ接続し、リポジトリとコミット履歴を分析して、コードベース固有の脅威モデルを作ります。この脅威モデルには、攻撃者の入口、信頼境界、機密データ、高インパクトなコードパスなどが含まれ、Codex Securityはそれを使って現実的な攻撃シナリオに分析を集中します。

| 観点 | Codex Securityの整理 | 確認した公式情報 |

|---|---|---|

| 位置づけ | アプリケーションセキュリティ向けAIエージェント | OpenAI公式発表 |

| 提供状況 | Research preview | OpenAI Help Center |

| 接続先 | 現在はGitHubリポジトリに直接接続する | OpenAI Help Center |

| 主な流れ | 識別、検証、修正提案 | OpenAI Help Center |

| 修正の扱い | 自動適用ではなく、人間レビュー用のパッチ案を提示する | OpenAI Help Center |

通常の OpenAI Codex が開発タスク、コード修正、テスト生成、業務自動化に広く使われるのに対し、Codex Securityは脆弱性発見と修正triageに焦点を絞っています。OpenAIの防御向けサイバー領域では GPT-5.4-Cyber のようなモデル提供の話もありますが、Codex Securityはモデル名ではなく、GitHubリポジトリを対象にしたセキュリティワークフローとして見るべきです。

Codex Securityで何ができるのか

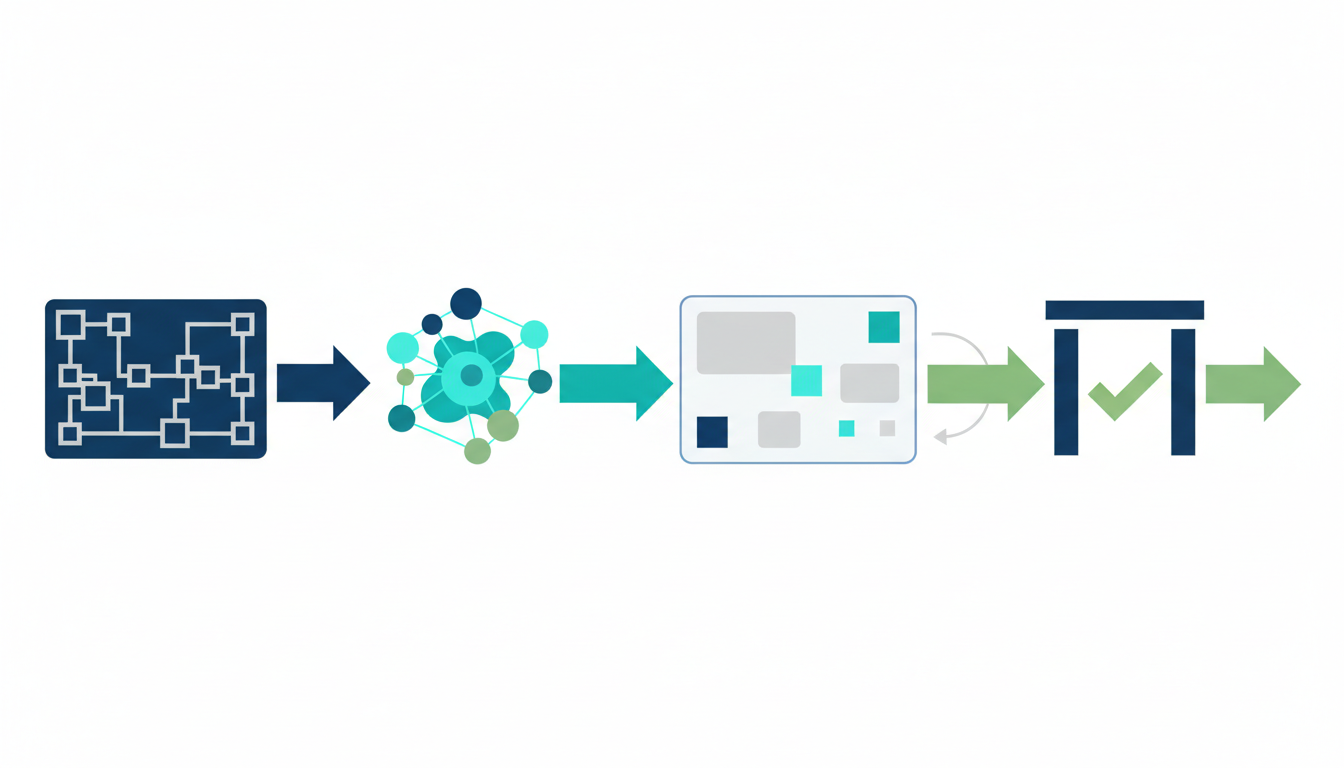

Codex Securityの中心は、識別、検証、修正提案の3段階です。従来の脆弱性スキャナーのように警告を出して終わるのではなく、見つけた問題が本当に悪用可能かを検証し、根本原因を直す最小パッチ案を生成し、人間が通常のワークフローでレビューできる形にすることを狙っています。

| 段階 | Codex Securityが行うこと | 実務での意味 |

|---|---|---|

| 1. リポジトリを分析 | GitHubリポジトリとコミット履歴を読み、コードベース固有の脅威モデルを作る | 単発ファイルではなく、システム全体の攻撃面を踏まえて見る |

| 2. 脆弱性を探索 | 脅威モデルを使い、攻撃入口から重要な結果へつながる現実的な経路を探す | 単なる危険文字列ではなく、悪用可能性と影響を優先できる |

| 3. sandboxで検証 | 自動validatorを隔離環境で動かし、再現結果や実行詳細を確認する | 誤検知を減らし、レビュー対象を高シグナルに寄せやすい |

| 4. パッチ案を生成 | 検証済みの問題に対して、根本原因を直す最小修正を提案する | 修正方針の議論からPR作成までの時間を短縮できる |

| 5. 人間がレビュー | 提案をそのまま適用せず、通常のレビューとPRフローに載せる | AIの誤りや副作用を、既存の開発統制で止められる |

| 6. 修正後に再検証 | 修正がmergeされた後、問題が解消されたかを再確認する | 発見から修正確認までのループを閉じられる |

OpenAIは、Codex Securityが攻撃経路の分析を出し、入力がどこから入り、どの信頼境界を越え、どの重要な結果に至るかを示すと説明しています。セキュリティチームにとっては、単に「危険そうな行」を見るのではなく、「このシステムで本当に直すべきリスクか」を判断しやすくなる点が価値です。

SASTと何が違うのか

SASTは、コードを静的に解析し、既知の危険パターン、データフロー、依存関係、シークレット、構文上の問題を継続的に検出するのが得意です。CIに組み込みやすく、開発チームの品質ゲートとして今後も重要です。一方で、複数ファイルにまたがる認可漏れ、ビジネスロジック上の抜け道、状態遷移の穴などは、ルールだけでは拾いにくいことがあります。

OpenAIは、Codex Securityを作る際にSASTレポートを最初に取り込んでtriageさせる設計にはしなかったと説明しています。発想としては、既存レポートの整理ではなく、リポジトリそのもの、アーキテクチャ、信頼境界、意図された振る舞いから出発し、見つけた問題を検証してから人間に提示する方向です。

| 比較軸 | SAST | Codex Security |

|---|---|---|

| 起点 | ルール、シグネチャ、データフロー、既知パターン | リポジトリ文脈、脅威モデル、攻撃経路、検証 |

| 得意領域 | 既知の危険実装、依存関係、シークレット、CIゲート | 文脈依存の脆弱性、複雑な認可、修正案の検討 |

| 出力 | 警告、ルール名、該当箇所、修正ヒント | 攻撃経路、再現検証、実行詳細、パッチ案 |

| 運用 | 継続的な自動検査に向く | 高リスク箇所の調査、triage、修正レビューに向く |

| 置き換え可否 | 基礎ゲートとして残すべき | SASTの上に重ねる補助線として使うのが現実的 |

したがって、Codex Securityを導入してもSAST、依存関係スキャン、シークレットスキャンを止める理由にはなりません。既知パターンは既存ツールで継続的に止め、Codex Securityでは「なぜその実装がこのシステムで危ないのか」「どの修正が副作用を抑えられるのか」を補う分担が安全です。これは AIリスクアセスメント と同じく、AIに任せる領域と人間が確認する領域を分ける設計です。

導入時に確認すべき注意点

Codex Securityは便利な機能ですが、セキュリティ領域で使う以上、導入時の確認を省くべきではありません。特に、対象リポジトリ、GitHub権限、脅威モデルの前提、検証環境、パッチPRのレビュー責任を決めないまま全社展開すると、検出結果の扱いや修正判断が曖昧になります。

| 確認項目 | 見るべき理由 | 実務アクション |

|---|---|---|

| 対象リポジトリ | いきなり全リポジトリを対象にするとtriage負荷が大きい | 外部公開API、認証、認可、決済、管理画面から始める |

| GitHub権限 | AIエージェントがコードと履歴を読むため、権限過多は避けたい | 専用groupや最小権限で接続し、不要なrepoを含めない |

| 脅威モデル | 前提がずれると、優先順位や影響評価もずれる | 入口、信頼境界、機密データ、重要機能をチームで確認する |

| 検出結果の共有範囲 | 脆弱性情報は公開範囲を誤るとリスクになる | Slack、Jira、PR、レポートの共有先を限定する |

| パッチレビュー | AIの修正案は正しいとは限らず、副作用もあり得る | 通常のPRレビュー、テスト、CI、セキュリティ承認を必須にする |

| internet accessとsecret | 外部アクセスやsecret混入はprompt injectionや流出リスクにつながる | Codexのネットワーク設定、許可ドメイン、secretの扱いを事前に決める |

Codex全般では、クラウドタスクがsandbox環境で動くこと、internet accessはデフォルトでoffだが必要に応じて設定できることがOpenAI docsで説明されています。internet accessを有効化する場合は、外部ページや依存関係READMEに含まれるprompt injection、コードやsecretの外部送信、マルウェア混入、ライセンス制約などのリスクを考える必要があります。開発系AIエージェントの権限設計は、AIエージェント ガバナンス や AIエージェントの権限設計 とセットで見た方が実務に落とし込みやすくなります。

企業での使い方と評価指標

企業でCodex Securityを試すなら、最初の目的は「大量の脆弱性候補を見つけること」ではなく、「既存ツールでは見落としやすい高インパクトな問題を、どれだけ少ないtriage負荷で扱えるか」を確認することです。検出数だけをKPIにすると、セキュリティチームも開発チームも通知疲れしやすくなります。

- まず対象を1から3リポジトリに絞り、認証、認可、外部入力、ファイルアップロードなど影響の大きい領域を優先する。

- Codex Securityが作る脅威モデルを確認し、実際のデプロイ構成、信頼境界、機密データの扱いと合っているかを直す。

- 初回スキャンでは、検出数ではなく、再現検証の有無、攻撃経路の納得感、修正案の妥当性を見る。

- パッチ案は専用ブランチやPRとして扱い、既存のレビュー、テスト、CI、SASTを通す。

- 却下したfindingには理由を残し、次回以降のtriageや脅威モデル修正に反映する。

評価指標としては、重大findingのprecision、再現済みfindingの比率、triageにかかった時間、修正PRまでのリードタイム、merge後の再検証結果が使いやすいです。OpenAIは公式発表で、beta期間中に過剰な重大度付けやfalse positive rateを改善してきたと説明していますが、自社コードで同じ効果が出るかは別問題です。自社のリポジトリ、レビュー体制、既存ツールとの重なりで評価する必要があります。

Claude Securityとの違い

同じ時期に、Anthropicの Claude Security もコードベースを読み、脆弱性検出、検証、パッチ提案を支援する機能として注目されています。両者は方向性が近く、従来の静的解析だけでは拾いにくい文脈依存の脆弱性を扱おうとしている点も共通しています。

違いを見るときは、モデル性能だけで比較するより、接続先、対象プラン、GitHub Appの権限、既存開発環境との統合、検出結果のワークフロー、監査ログ、パッチPRの扱いを見る方が実務的です。Codexをすでに開発・レビュー・自動化に使っている組織ならCodex Securityは自然に検討候補に入り、Claude Code中心のチームならClaude Securityを比較軸に置くと判断しやすくなります。

| 観点 | Codex Security | Claude Security |

|---|---|---|

| 提供元 | OpenAI | Anthropic |

| 主な対象 | Codex / GitHubリポジトリを前提にしたセキュリティワークフロー | Claude / Claude Code on the Webを前提にしたセキュリティスキャン |

| 共通点 | 脆弱性の発見、検証、修正案、人間レビュー | 脆弱性の発見、検証、修正案、人間レビュー |

| 比較時の焦点 | Codexの開発ワークフロー、GitHub連携、脅威モデルの編集性 | Claude Code運用、対象プラン、データ保持、連携先 |

よくある質問

Codex Securityとは何ですか?

Codex Securityは、OpenAIがresearch previewとして提供するアプリケーションセキュリティ向けのAIエージェントです。GitHubリポジトリを読み、コードベース固有の脅威モデルを作り、脆弱性を探索し、sandboxで検証し、人間レビュー用の修正パッチを提案します。

Codex Securityは誰が使えますか?

OpenAIの公式発表では、ChatGPT Pro、Enterprise、Business、Eduの顧客にCodex web経由でresearch previewとして展開されると案内されています。実際の利用可否は、ChatGPTのCodex Security画面、ワークスペース設定、管理者権限、対象プランで確認してください。

Codex SecurityはGitHub以外のリポジトリにも使えますか?

2026年5月1日時点でOpenAI Help Centerは、Codex SecurityがGitHubリポジトリに直接接続すると説明しています。GitHub Enterprise Server、GitLab、Bitbucket、自社ホストのリポジトリについては、最新の対応状況を個別に確認する必要があります。

Codex SecurityはSASTを置き換えますか?

置き換え前提で考えない方が安全です。SAST、依存関係スキャン、シークレットスキャンは継続的な自動ゲートとして残し、Codex Securityは文脈依存の脆弱性、攻撃経路の検証、修正案のtriageを補う位置づけで使うのが現実的です。

Codex Securityのパッチは自動で適用されますか?

いいえ。OpenAI Help Centerでは、Codex Securityはパッチを人間レビュー用に提示し、必要に応じてpull requestへ進める流れだと説明されています。修正案は必ずレビュー、テスト、CI、セキュリティ承認を通して扱うべきです。

Codex Securityを使う前に何を決めるべきですか?

対象リポジトリ、GitHub権限、脅威モデルの前提、検出結果の共有先、パッチPRの承認者、再検証の条件を先に決めるべきです。特にinternet accessやsecretの扱いは、Codex全体のセキュリティ設定と合わせて確認する必要があります。