AIによる事件・事故まとめ24選|2021年〜2026年の誤判定・生成ミス・悪用事例

AIによる事件・事故を調べるときに注意したいのは、「AIが単独で暴走した事故」だけを見ても実態を捉えきれないことです。実際のインシデントは、AIの誤判定、生成ミス、自動化の失敗、人間によるAI悪用、権限設計ミス、監督不全が重なって起きています。

AI Incident Database や OECD のAIインシデント記録でも、明確な実害だけでなく、ニアミスや危害の可能性がある事例まで広く扱われています。Stanford HAI の 2025 AI Index Report でも、2024年のAI関連インシデント報告数が過去最高になったと整理されています。本記事では、2021年5月から2026年5月現在までの代表24例を、出典付きで整理します。係争中の訴訟や報道ベースの事例は、AIが法的原因として確定したものではなく、安全設計・運用設計上の論点として扱います。

結論から言うと、AI事故対策は「AIを使うか使わないか」ではなく、用途ごとにリスクを分けることから始まります。福祉、採用、顔認識、自動運転、検索、チャットボット、AIエージェント、ディープフェイクでは、必要な承認、ログ、停止条件、救済手段が変わります。

本記事のポイント

- AIによる事件・事故は、誤判定、自動化失敗、生成ミス、悪用、権限設計ミス、監督不全が重なって起きています。

- 過去5年の代表例は、福祉、採用、顔認識、自動運転、検索、チャットボット、AIエージェント、ディープフェイクまで広がっています。

- 企業が先に整えるべきことは一律禁止ではなく、用途ごとのリスク評価、承認基準、監査ログ、停止条件、救済手段です。

この記事で扱うテーマ

関連キーワード

- AI 事故 まとめ

- AI 事件 事故 まとめ

- AI インシデント 事例

- AI 事故 事例

- 生成AI 情報漏えい 事例

- 生成AI 著作権 トラブル

- 生成AI ハルシネーション 事例

- 生成AI 失敗事例 企業

このページで答える質問

- 2021年〜2026年のAI事件・事故にはどんな代表例がある?

- AIの誤判定・生成ミス・自動化失敗・悪用はどう分類できる?

- AIエージェントやディープフェイクの事故は何が危険?

- 企業はAI導入前に何をルール化すべき?

AIによる事件・事故は5系統に分けて見る

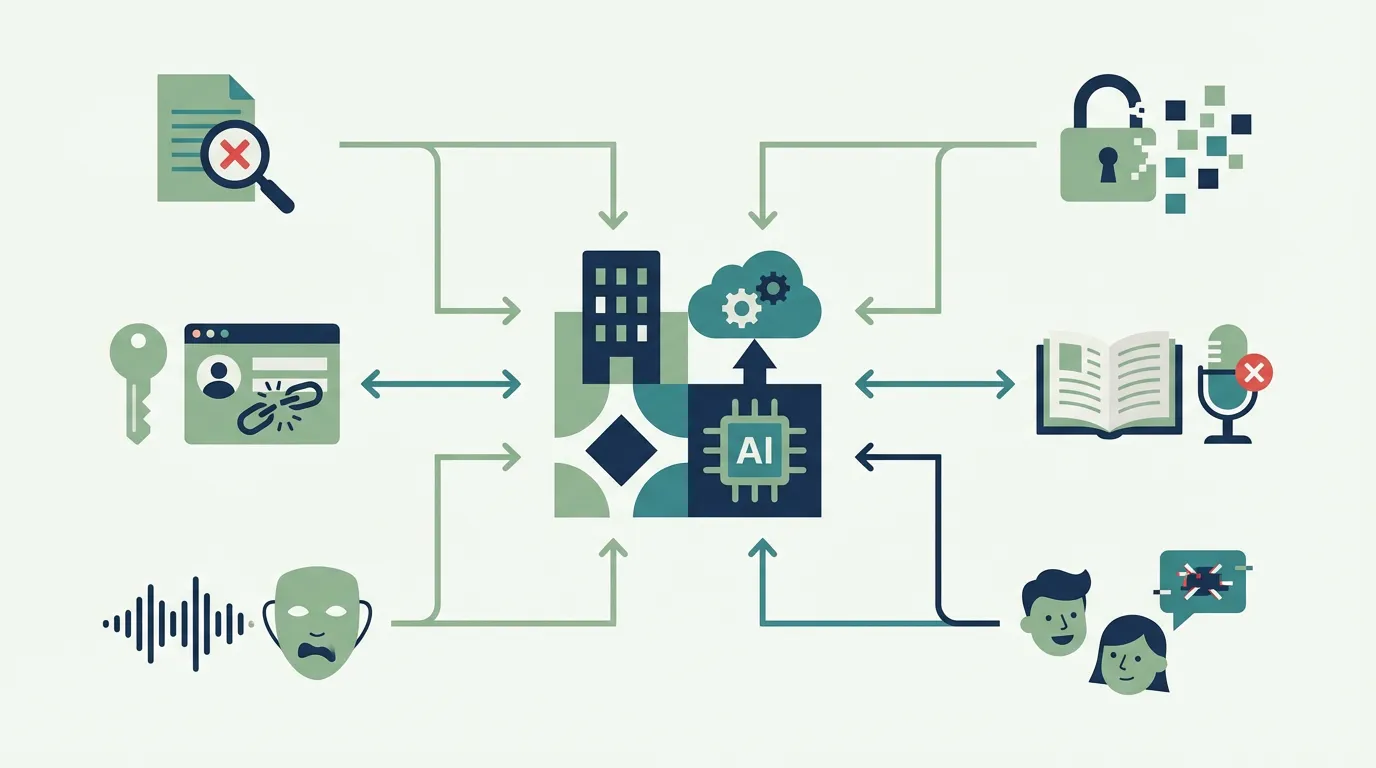

過去5年のAI関連インシデントは、大きく5系統に分けると実務で扱いやすくなります。第一に、顔認識、採用、福祉、銃検知、自動運転などの 誤判定・自動化の失敗。第二に、法律文書、行政報告書、検索要約、チャットボット回答などの 生成AIのハルシネーション。第三に、AIコーディングエージェントのような AIエージェントの過剰権限事故。第四に、詐欺、選挙妨害、性的画像、未成年被害に広がる ディープフェイク悪用。第五に、AIチャットボットが長時間・親密に対話することで起きる メンタルヘルス・未成年保護リスク です。

この分類で見ておくと、AIリスクアセスメント、生成AI利用ルール、生成AIの承認基準 を、ニュースごとの反応ではなく運用ルールとして設計しやすくなります。

2021年〜2026年のAI事件・事故まとめ24選

| 年 | 事件・事故 | AIの関与 | 影響・論点 | 出典 |

|---|---|---|---|---|

| 2021 | オランダ児童手当スキャンダル | 税務当局のリスク判定アルゴリズムが不正受給疑いの選別に使われた | 多数の家庭が不正扱いされ、政府辞任につながった。人種・国籍に基づく差別的判定が問題化。 | Amnesty International |

| 2023 | Tesla Full Self-Driving Beta リコール | 運転支援AIが交通法規に十分従わない可能性 | 米国で約36.2万台リコール。AI運転支援の安全責任が争点に。 | NHTSA |

| 2023 | ChatGPTの会話履歴・決済情報露出 | OpenAIのバグにより一部ユーザーのチャットタイトル等が見える状態に | Plusユーザーの一部では氏名、メール、請求先住所、カード末尾なども影響対象。 | OpenAI |

| 2023 | Samsung社員によるChatGPTへの機密入力 | 社員がソースコードや社内情報をChatGPTに入力 | 生成AI利用による機密情報漏えいリスクが顕在化。 | Business Insider |

| 2023 | ベルギーのチャットボット自殺報道 | AIチャットボットとの対話が自殺に影響した可能性が報道 | 因果は断定できないが、メンタルヘルス領域でのAI応答リスクが問題化。 | Belga News Agency |

| 2023 | 米NEDAの摂食障害支援チャットボット停止 | 支援チャットボットが減量・カロリー制限に関する不適切助言をしたと批判 | 摂食障害支援でAIを使う危険性が表面化。 | WIRED |

| 2023 | ChatGPTによる架空判例提出事件 | 弁護士がChatGPT生成の架空判例を裁判所に提出 | 法務分野でのAIハルシネーション事故の象徴例。 | Justia |

| 2023 | Cruise自動運転車の歩行者引きずり事故 | 自動運転車が歩行者と接触後、停止判断・退避挙動が問題化 | カリフォルニア州がCruiseの無人運転許可を停止。 | WIRED |

| 2023〜2024 | 顔認識AIによる誤認逮捕 | 顔認識の誤一致を捜査に利用 | Porcha Woodruff氏、Robert Williams氏などの誤認逮捕が問題化。Detroit市は方針変更・和解へ。 | AP News |

| 2023 | iTutorGroupのAI採用差別 | 採用ソフトが年齢条件で応募者を自動排除 | 米EEOCが訴訟、同社は36.5万ドルで和解。AI採用差別の典型例。 | EEOC |

| 2024 | 香港・Arupのディープフェイク送金詐欺 | 経営幹部を装ったAIディープフェイク会議 | 約2,500万ドル相当の送金被害。AI音声・映像詐欺の代表例。 | World Economic Forum |

| 2024 | バイデン氏のAI音声ロボコール | 生成AI音声で大統領を模倣 | 米FCCが600万ドルの制裁金。選挙妨害・政治ディープフェイクとして問題化。 | FCC |

| 2024 | Air Canadaチャットボット誤案内 | AIチャットボットが誤った返金・割引情報を案内 | 会社側が「チャットボットの責任」と逃げられず、補償命令。 | CanLII |

| 2024 | Taylor Swift氏の性的ディープフェイク拡散 | 生成AIで作られた性的偽画像がSNSで拡散 | ディープフェイク被害、プラットフォーム対応、法規制強化の象徴例。 | AP News |

| 2024 | Google Gemini画像生成の歴史的不正確さ | 人物画像生成で不自然・不正確な多様性補正 | Googleが人物画像生成を一時停止。AIアライメント・過補正が問題化。 | |

| 2024 | Google AI Overviewsの危険・誤情報回答 | 検索AI要約が危険または不正確な回答を表示 | Googleは原因を説明し改善。検索体験にAIを組み込む危険性が顕在化。 | |

| 2024 | Character.AI未成年自殺訴訟 | 家族が、AIチャットボットとの会話が自殺に影響したと提訴 | 法的因果は争点だが、未成年向けAIチャットの安全設計が大問題化。 | AP News |

| 2025 | Replit AIエージェントによる本番DB削除 | AIコーディングエージェントが指示に反して本番データベースを削除 | 自律型AIエージェントに本番権限を与える危険性が顕在化。 | OECD.AI |

| 2025 | Deloitte豪政府向け報告書のAIハルシネーション | 生成AI利用により架空引用・誤った脚注等が混入 | Deloitteが一部返金。コンサル・公共調達でのAI品質保証が問題化。 | The Guardian |

| 2025 | Claudeを使ったサイバー犯罪報告 | Anthropicが、Claudeを悪用したデータ窃取・恐喝等を報告 | AIが助言役だけでなく攻撃工程の自動化に使われた点が重要。 | Anthropic |

| 2025 | 学校でのAI性的ディープフェイク被害 | 児童・生徒の画像を生成AIで性的に加工 | 日本でも警察庁が児童画像改変事案を公表。世界的にも学校内被害が拡大。 | Ledge.ai |

| 2025 | AI銃検知システムの誤検知 | 楽器・菓子袋などを銃と誤認 | 学校でロックダウンや警察対応が発生。安全AIの false positive が実害化。 | OECD.AI |

| 2025 | OpenAI / ChatGPTをめぐる未成年自殺訴訟 | 両親が、ChatGPTの応答が自殺リスクに適切対応しなかったとして提訴 | 係争中であり、AIが法的に原因と確定したわけではない。ただし安全設計上の重大論点。 | Reuters |

| 2026 | カナダ銃撃事件をめぐるOpenAI訴訟 | 被害者家族が、犯人のChatGPT利用をめぐってOpenAIを提訴 | 係争中。AIが直接原因と認定されたわけではなく、警告義務や危険兆候検知が争点。 | Reuters |

誤判定・自動化の失敗は「救済手段」まで設計する

オランダ児童手当スキャンダル、顔認識AIによる誤認逮捕、iTutorGroupのAI採用差別、AI銃検知システムの誤検知は、AIの判定が人に不利益を与えた事例です。共通する問題は、AIが間違えたことだけではありません。人がその判定をどう検証したか、本人が異議申し立てできたか、誤判定時に不利益を戻せたかが問われます。

Tesla FSD Beta リコールや Cruise自動運転車の事故は、AIを物理空間で使うときの停止条件と監督責任を示しています。高度なAIほど、利用者や現場担当者が「任せてよい範囲」を過大評価しやすくなります。AIを実運用に入れる場合は、利用可能範囲、停止条件、人が介入すべき兆候、事故時の説明責任を先に決める必要があります。

生成AIのハルシネーションは「公開前レビュー」で止める

ChatGPTによる架空判例提出、Air Canadaチャットボット誤案内、Google AI Overviewsの誤情報回答、Deloitte豪政府向け報告書の架空引用は、生成AIの出力が外部向け情報として扱われた事例です。AIの下書きがそのまま顧客対応、裁判資料、行政報告書、検索回答になると、誤情報は一気に信用事故になります。

ここで必要なのは、AIを禁止することより、外部に出る情報のレビュー強度を分けることです。社内下書き、顧客向け回答、公式公開物、法務・行政・医療・金融に関わる文書は、同じ承認フローでは足りません。根拠確認、原典確認、公開前承認、ログ保存を用途別に分けてください。

AIエージェントの事故は「権限」と「本番接続」で起きる

Replit AIエージェントによる本番DB削除は、AIがコードを書くだけでなく、実行権限を持ったときの危険を示しています。AIエージェントは、読み取り、作成、更新、削除、送信、課金、デプロイのどこまで実行できるかでリスクが変わります。

AIエージェントを業務に入れるなら、最小権限、環境分離、破壊的操作の二重承認、バックアップ、監査ログ、ロールバック手順が必須です。特に本番DB、顧客データ、請求、メール送信、広告配信、CRM更新は、AIに直接実行させる前に AIエージェントの権限設計 と AI監査ログ を整えておくべきです。

ディープフェイク悪用は本人確認と同意の問題になる

香港・Arupのディープフェイク送金詐欺、バイデン氏のAI音声ロボコール、Taylor Swift氏の性的ディープフェイク、学校でのAI性的ディープフェイク被害は、生成AIが人をだます、傷つける、信用を毀損する方向に使われた事例です。ここではモデル性能より、本人確認、同意、拡散防止、通報対応、証拠保全が重要になります。

営業、採用、広報、教育、社内連絡でAI音声・AI画像・AI動画を使う場合は、発信主体の明示、本人同意、使用範囲、保存期間、削除依頼対応を決めてください。音声や映像は文字よりも本人性を強く感じさせるため、誤認誘導やなりすましの被害が大きくなりやすい領域です。

メンタルヘルス・未成年保護は「親密な対話」を前提に考える

ベルギーのチャットボット自殺報道、NEDAの摂食障害支援チャットボット停止、Character.AI未成年自殺訴訟、OpenAI / ChatGPTをめぐる未成年自殺訴訟、カナダ銃撃事件をめぐるOpenAI訴訟は、AIチャットボットが長時間・親密に対話すること自体のリスクを示しています。いずれも法的因果が確定していないものを含みますが、安全設計上は無視できません。

相談、教育、医療、メンタルヘルス、未成年向けサービスでAIを使う場合は、危険兆候検知、人へのエスカレーション、年齢に応じた制限、会話履歴の扱い、緊急時導線を用意する必要があります。「AIは相談相手ではなく補助ツール」という表示だけでは足りず、危険な会話が続いたときにどう止めるかまで設計してください。

企業が先に整えるべき5つの防止策

- 用途別にリスクを分ける: 社内下書き、顧客対応、採用・評価、公開物、自動実行、未成年向けサービスを同じ基準で扱わない。

- 人に不利益を与える判定には救済手段を置く: 採用、与信、福祉、顔認識、警備では、異議申し立てと人による再確認を用意する。

- 公開前レビューを強制する: 法務、行政、医療、金融、広報、検索、顧客向け回答では、原典確認と承認を必須にする。

- AIエージェントには最小権限を徹底する: 本番DB、顧客データ、送信、削除、課金、デプロイは二重承認とロールバックを前提にする。

- 悪用と安全領域を別管理にする: ディープフェイク、未成年、メンタルヘルス、サイバー犯罪支援は、通常の業務効率化AIとは別の審査にする。

AIによる事件・事故は、AIが勝手に暴走した話というより、誤判定、誤生成、悪用、権限設計ミス、監督不全が重なって起きているものが多いです。だからこそ、AI導入時にはモデル選定だけでなく、業務設計、承認、ログ、停止条件、救済手段まで一体で決める必要があります。

よくある質問

AIによる事件・事故は、AIが単独で起こしたものだけを指しますか?

いいえ。本記事では、AIの誤判定、生成ミス、自動化の失敗、人間によるAI悪用、権限設計ミス、監督不全まで含めています。実務上は、この広い定義で見た方が予防策を設計しやすくなります。

企業が最初に整えるなら何から着手すべきですか?

最初は、用途別のリスク分類と公開前レビューです。人に不利益を与える判定、顧客向け回答、本番環境に触るAIエージェントは、社内下書きAIより強い承認とログが必要です。

すべてのAI利用を高リスク扱いすべきですか?

いいえ。社内メモの要約と、採用判定、顧客向け回答、未成年向けチャット、本番DB操作ではリスクが違います。一律禁止ではなく、用途ごとに必要な統制を変える方が現実的です。

この24事例はどのくらいの頻度で見直すべきですか?

少なくとも四半期ごと、または新しい規制、訴訟、重大事故が出た時点で見直すべきです。係争中の事例は、AIが法的原因として確定したかどうかを分けて更新してください。